Cuộc chơi mới: Khi “ông lớn” AI phải dè chừng

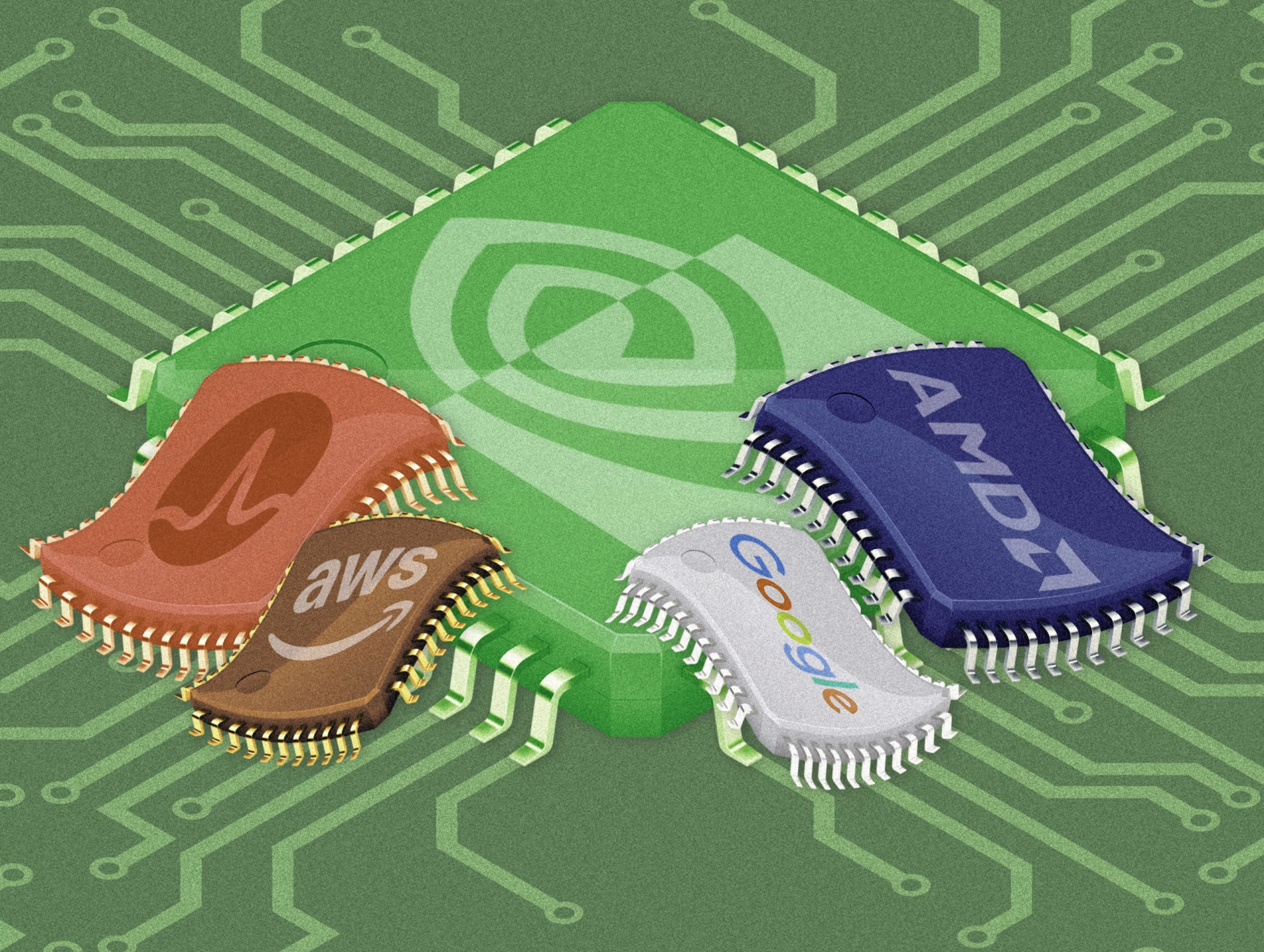

Trong hơn một thập kỷ, NVIDIA gần như không có đối thủ xứng tầm – là thương hiệu hàng đầu cho các GPU dùng trong huấn luyện và vận hành mô hình trí tuệ nhân tạo (AI). Nhưng theo báo cáo mới nhất của WSJ, thế cân bằng trên thị trường chip AI đang lung lay, khi một loạt “ông lớn” công nghệ và bán dẫn bắt đầu tung ra chip AI riêng, hòng thách thức vị thế thống trị của NVIDIA.

Đối thủ mới không chỉ là các nhà sản xuất chip truyền thống, mà là các “hyperscaler” – những công ty công nghệ khổng lồ sở hữu đám mây dữ liệu lớn – như Google hay Amazon. Họ phát triển chip chuyên dụng (ASIC / TPU / XPU) tối ưu cho workloads AI cụ thể, thay vì dùng GPU chung chung.

Thêm vào đó, các công ty thiết kế chip “thuần” như AMD hay Broadcom cũng gia nhập cuộc đua mạnh mẽ. Họ không chỉ cung cấp chip, mà còn xây dựng hệ thống phần mềm – phần cứng – hạ tầng để đáp ứng nhu cầu ngày càng lớn của AI doanh nghiệp.

Kết quả: Những “sân chơi riêng” xưa nay dành cho GPU của NVIDIA giờ phải chia sẻ không gian với nhiều loại chip, nhiều nền tảng – và thị trường chip AI bắt đầu biến động đáng kể.

Vì sao các ông lớn nhảy vào mảng chip AI?

Tối ưu chi phí & hiệu năng

Chip chuyên dụng (ASIC / TPU / XPU) mà Google, Amazon, Broadcom dùng thường được thiết kế để xử lý một số tác vụ AI nhất định – inference, đào tạo mô hình, xử lý dữ liệu – theo kiểu “tối ưu hoá cao độ”. Điều này giúp chúng thường rẻ hơn và hiệu quả hơn so với GPU “đa dụng”, ít nhất cho các workloads mà chúng được thiết kế để làm tốt.

Với những công ty như Google và Amazon, tự phát triển chip giúp họ giảm phụ thuộc vào nhà cung cấp bên ngoài – như NVIDIA – đồng thời kiểm soát được chi phí, hiệu năng, và hạ tầng AI dài hạn một cách chặt chẽ hơn.

Đáp ứng khối lượng khổng lồ & nhu cầu đa dạng

Khi các ứng dụng AI (từ dịch vụ cloud, chatbot, xử lý dữ liệu, inference, training… ) tăng vọt – nhu cầu về chip AI không chỉ dừng lại ở GPU server cao cấp. Nhiều workloads không cần GPU mạnh mẽ, mà cần chip phù hợp, hiệu quả chi phí, tối ưu hóa cho sử dụng thực tế. Chip tùy chỉnh do Google, Broadcom, AMD phát triển có thể phục vụ tốt các nhu cầu đó.

Đồng thời, các doanh nghiệp thuê dịch vụ hay xây dựng hạ tầng AI riêng cũng muốn giải pháp “tối ưu – rẻ hơn – dễ nhân rộng” hơn GPU cao cấp, tạo cơ hội cho chip thay thế.

Cắt giảm phần “giá trị dư thừa”, khai thác lợi nhuận

Với GPU cao cấp, chi phí sản xuất, phần mềm, licensing… thường cao, đắt đỏ – dẫn đến lợi nhuận rất lớn đối với nhà sản xuất như NVIDIA. Tuy nhiên, đó cũng là nơi mà đối thủ có thể “chạm” tới: bằng chip rẻ hơn, tùy chỉnh hơn, vẫn đáp ứng đủ yêu cầu. Phần lớn các công ty mới đều chọn con đường “hiệu suất – chi phí”, để hút các khách hàng doanh nghiệp, startup, hoặc người cần scale lớn.

Với AMD, Broadcom – hai cái tên nổi bật – việc chip của họ được dùng bởi những khách hàng lớn như OpenAI, các doanh nghiệp cloud, data-center, giúp họ mở rộng thị phần, và có thể định hình một phần “chuỗi giá trị AI” khác với mô hình GPU “đơn lẻ” truyền thống.

Đối thủ nào đáng kể?

Google & Amazon

-

Google: Theo nhiều báo cáo, Google đang đẩy mạnh việc bán chip AI (TPU/XPU) đến các trung tâm dữ liệu, thậm chí cho các công ty bên ngoài. Điều này tạo ra một kênh phân phối chip “nội bộ + thương mại” rộng lớn.

-

Amazon: Với dòng chip AI riêng – ví dụ như sản phẩm mới nhất – Amazon nhắm tới việc cung cấp giải pháp AI cho hệ thống cloud của họ, giảm phụ thuộc vào GPU của NVIDIA, và đồng thời cung cấp cho khách hàng dịch vụ AI “tout-in-one” với chi phí hiệu quả hơn.

AMD

AMD – với kinh nghiệm lâu năm trong sản xuất CPU/GPU & hardware – đang tận dụng cơ hội để “chen chân” vào thị trường AI bằng chip chuyên dụng/ tùy chỉnh, kết hợp với phần mềm và hệ thống data-center. Điều này khiến họ trở thành một đối thủ đáng gờm, đặc biệt với doanh nghiệp lớn hoặc các tổ chức cần hạ tầng AI quy mô.

Broadcom

Broadcom nổi bật với việc phát triển các chip AI/XPU theo đặt hàng từ các công ty lớn, và đã hợp tác với OpenAI để xây dựng hệ thống AI quy mô gigawatt. Họ được xem là một trong những “nhà sản xuất chip bí mật” nhưng có tiềm lực lớn và đang khẳng định vị trí trong chuỗi cung ứng AI toàn cầu.

Vì sao cuộc đua càng thêm phức tạp – và NVIDIA vẫn chưa mất vị thế

Một số phân tích cho rằng dù áp lực tới từ mọi hướng, NVIDIA vẫn duy trì lợi thế đáng kể:

-

GPU của NVIDIA vẫn được xem là tiêu chuẩn vàng trong việc huấn luyện và vận hành các mô hình AI lớn – đặc biệt các mô hình generative AI phức tạp cần sức mạnh tính toán cực cao.

-

Lợi nhuận biên (profit margin) và cấu trúc phần mềm/hệ sinh thái mà NVIDIA xây dựng từ trước vẫn rất mạnh – giúp họ giữ chân khách hàng lớn, đặc biệt các khách hàng enterprise cần độ ổn định, performance, và hệ sinh thái hoàn chỉnh.

-

Không phải mọi workloads AI đều phù hợp với chip tùy chỉnh: GPU – với sự linh hoạt cao – vẫn có lợi thế khi công việc đòi hỏi tính tổng quát, đa nhiệm, hoặc khi mô hình thay đổi nhanh. Điều này giúp NVIDIA giữ chân phần thị trường không dễ bị “tùy chỉnh hóa”.

Vì vậy, thay vì một “cuộc hủy diệt” – có lẽ chúng ta sẽ chứng kiến một thị trường đa dạng hơn: nơi GPU mạnh vẫn tồn tại, song chip ASIC / TPU / XPU sẽ chiếm phần đáng kể, đặc biệt cho workloads quy mô lớn, cụ thể, hoặc cần tối ưu chi phí.

Hậu quả: Thay đổi cấu trúc thị trường chip và AI

Đa dạng hoá nguồn chip – tăng lựa chọn cho doanh nghiệp

Trước đây, nếu một công ty muốn chạy AI ở quy mô lớn, lựa chọn phổ biến là dùng GPU NVIDIA. Bây giờ, họ có thêm lựa chọn: chip tùy chỉnh từ Google, Amazon, AMD, Broadcom – có thể rẻ hơn, phù hợp hơn với workload, dễ nhân rộng.

Điều này giúp giảm bớt “độc quyền phần cứng”, khiến thị trường AI trở nên mở hơn, linh hoạt hơn và không phụ thuộc vào một nhà cung cấp duy nhất.

Giảm chi phí – mở rộng khả năng áp dụng AI

Với chip rẻ hơn, hiệu năng / chi phí tốt hơn, nhiều doanh nghiệp – từ startup, doanh nghiệp vừa & nhỏ – có thể tiếp cận AI dễ hơn. Đó có thể là bước quan trọng để AI phổ biến rộng rãi hơn, vượt ra khỏi giới “đại tập đoàn công nghệ.”

Áp lực lên NVIDIA – buộc đổi mới & duy trì lợi thế

NVIDIA sẽ phải liên tục đổi mới – cả về hiệu năng, phần mềm, hệ sinh thái – nếu muốn giữ vị thế. Họ không thể “ngủ quên” vì đối thủ đang tiến rất nhanh, với lợi thế về chi phí, thiết kế tùy chỉnh, và khả năng tích hợp chặt chẽ với hệ sinh thái riêng.

Chuỗi cung ứng & thị trường chip biến động

Với nhiều nhà cung cấp, thị trường chip AI có thể trở nên “nhiều tầng”: từ GPU cao cấp, chip chuyên dụng, đến ASIC – mỗi lớp phục vụ nhu cầu khác nhau. Điều đó dẫn tới cạnh tranh khốc liệt, nhưng cũng thúc đẩy đổi mới.

Kết luận: Một “kỷ nguyên chip AI đa cực” đang hình thành

Cuộc đua chip AI không còn đơn giản giữa “anh cả GPU” và các hãng nhỏ lẻ – mà là giữa các đại công ty công nghệ, các nhà sản xuất chip truyền thống, và những người mới nhảy vào với chiến lược tùy chỉnh, tối ưu chi phí.

NVIDIA – dù vẫn giữ vị thế hàng đầu – đang phải đối mặt với áp lực lớn chưa từng có. Google, Amazon, AMD, Broadcom… mỗi bên đều có lợi thế riêng: phần mềm + hệ sinh thái + chi phí + quyền kiểm soát hạ tầng.

Kết quả là: thị trường chip AI đang chuyển từ “một cực” (NVIDIA) sang “đa cực”. Đây có thể là tin tốt cho ngành AI nói chung – bởi sự đa dạng sẽ thúc đẩy đổi mới, giảm chi phí, và mở cửa cho nhiều đối tượng hơn tham gia. Nhưng với NVIDIA – cũng là lời cảnh báo: nếu không tiếp tục đổi mới, họ rất dễ bị “chia phần” thị trường.